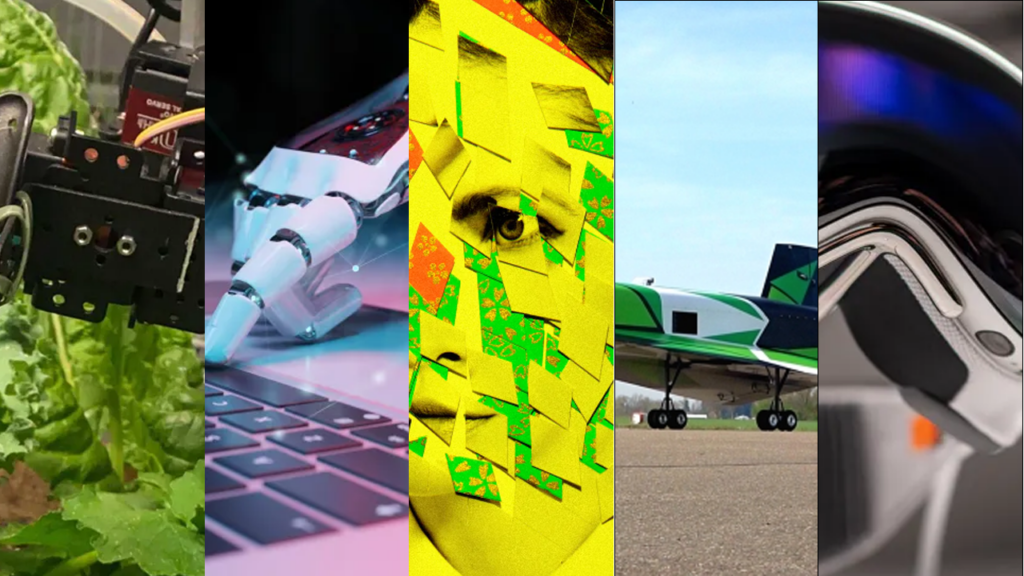

A Carta do Especialista de hoje foi escrita por Inteligência Artificial. Ou não? Como saber a diferença, em tempos que robôs de jardinagem estão passando pelo Teste de Turing e a IA está passando a ser a estrela principal dos cursos de computação de Harvard? E não como matéria e sim como na função de professora! Se para você estes argumentos não forem suficientes, chegamos a um momento que a linha entre nossas memórias reais e aquelas sonhadas por uma IA, está ficando borrada…Sim…Um perigo…E, como tudo está indo numa velocidade exponencial, conheça o novo avião que pode viajar numa velocidade 5 vezes maior do que o som, reduzindo o tempo de viagem entre EUA e Australia, de 17 para 4 horas. E finalizo a Carta com uma análise do lançamento dos óculos de realidade virtual e mista da Apple, que talvez nos faça avançar mais um passo na jornada de busca de um Metaverso ideal.

🤖Robôs de Jardinagem passam no Teste de Turing

Na Carta do Especialista da semana passada (Clique aqui para ler), focada em IA, comentei a respeito do Teste de Turing, desenvolvido em 1950 por Alan Turing, que levantou a questão “Máquinas podem pensar?” propondo um teste baseado na comparação entre a capacidade humana e a capacidade da máquina em responder perguntas.

Começo a Carta de hoje aproveitando a este link e adaptando a pergunta para as “Máquinas podem jardinar?”, através da comparação entre a habilidade humana e de uma máquina em cuidar de um jardim de policultura real.

A Universidade da Califórnia, Berkeley, tem uma longa história de pesquisa em jardins robóticos, que remonta ao início dos anos 90, quando já cuidavam de um jardim inteiro com a ajuda de um robô. Contudo, a verdadeira questão hoje é: o robô pode cuidar de um jardim de forma tão eficaz quanto um humano? Vamos agora adentrar o campo da CIÊNCIA! 👏

Diretamente de Berkeley, um avançado robô chamado AlphaGarden, com habilidades superiores às de um jardineiro profissional, está redefinindo os cuidados com as plantas. Esses robôs não são sofisticados; são sistemas hidropônicos automatizados que controlam a água, os nutrientes e até mesmo a luz solar simulada. Eles fazem um trabalho incrível gerando evidências de que os jardineiros robóticos podem ser tão eficientes quanto os melhores jardineiros humanos e, em alguns aspectos, até superá-los.

O AlphaGarden é uma combinação de um sistema de cultivo robótico em um pórtico comercial e o AlphaGardenSim, um software desenvolvido pela UC Berkeley que instrui o robô sobre como maximizar a saúde e o crescimento das plantas. O sistema inclui uma câmera de alta resolução e sensores de umidade do solo para monitorar o crescimento das plantas. Tudo é automatizado, desde o plantio de sementes até a irrigação por gotejamento e a poda. O jardim em si é complexo, sendo um jardim de policultura, onde diferentes plantas coexistem. Esse tipo de cultivo imita o crescimento natural das plantas e traz benefícios como a resistência a pragas, a redução da necessidade de adubação e a melhoria da saúde do solo. No entanto, a policultura requer mais trabalho manual do que a monocultura, que é o método predominante na agricultura em larga escala.

Para avaliar o desempenho do AlphaGarden, os pesquisadores da UC Berkeley realizaram um experimento. Eles plantaram duas áreas agrícolas lado a lado, utilizando as mesmas sementes. Ao longo de dois meses, o AlphaGarden cuidou de uma das áreas em tempo integral, enquanto jardineiros profissionais cuidaram da outra área. Em um segundo teste, o AlphaGarden teve permissão para plantar as sementes em diferentes momentos, dando uma vantagem inicial às plantas de crescimento mais lento. Durante o experimento, um ser humano precisou ajudar o robô ocasionalmente com a poda, seguindo as instruções fornecidas pelo próprio robô quando a ferramenta de poda não conseguia realizar determinadas tarefas.

Os resultados desses testes mostraram que o robô alcançou resultados semelhantes ao jardineiro profissional em termos de diversidade e cobertura das plantas. Em outras palavras, as plantas cresceram tão bem com os cuidados do robô quanto com os cuidados de um jardineiro humano experiente. A diferença significativa foi que o robô conseguiu realizar a tarefa com um consumo de água 44% menor, economizando centenas de litros em apenas dois meses.

O futuro desse campo ainda é incerto, uma vez que o custo do hardware é elevado, enquanto a mão de obra humana é relativamente mais acessível. No entanto, para aqueles de nós que não são especialistas em jardinagem, é fácil imaginar a instalação de câmeras e sensores em nossos jardins, seguido as orientações de um simulador sobre quando e onde regar e podar. Estou sempre disposto a ceder o trabalho para um robô que sabe fazer melhor do que eu. 😅’ E você?

Fonte: https://spectrum.ieee.org/robot-gardener

🖥Professor de Harvard aproveita IA para ajudar a dar a aula de computação

O CS50, o curso de ciência da computação mais popular do mundo, oferecido pela Universidade de Harvard, está passando por uma transformação na era do ChatGPT. O professor David J. Malan, responsável pelo curso, planeja utilizar inteligência artificial para avaliar tarefas, ensinar programação e fornecer dicas personalizadas de aprendizagem.

O estilo de ensino enérgico e envolvente de Malan tem sido elogiado por transformar palestras monótonas e básicas sobre os fundamentos do desenvolvimento web e programação de software em aulas divertidas, repletas de exercícios interativos. No entanto, com o crescente número de alunos conectados de fusos horários diferentes e com diferentes níveis de conhecimento e experiência, tornou-se desafiador oferecer suporte individualizado às perguntas específicas dos alunos.

Para lidar com esse desafio em grande escala, a equipe do CS50 está desenvolvendo um sistema de inteligência artificial para avaliar o trabalho dos alunos e testando um assistente de ensino virtual para avaliar e fornecer feedback sobre a programação dos estudantes. O assistente virtual faz perguntas retóricas e oferece sugestões para auxiliar no aprendizado, em vez de simplesmente detectar erros e corrigir bugs de programação. A ideia é que, a longo prazo, isso permita que os assistentes de ensino humanos tenham mais tempo para interagir presencialmente ou por meio de videochamadas.

Essa iniciativa ocorre em um momento em que os educadores estão preocupados com o fato de que tecnologias como o ChatGPT possam facilitar a trapaça e a plágio por parte dos alunos, sem serem detectados. Algumas escolas e universidades em todo o mundo já proibiram o uso desse tipo de ferramenta. Além disso, o avanço da inteligência artificial também afetou as ações de empresas de educação online, como a Chegg Inc., que recentemente registrou uma desaceleração no crescimento de assinantes à medida que as pessoas experimentam o chatbot gratuito desenvolvido pela OpenAI.

No entanto, Malan argumenta que o uso da inteligência artificial pelo CS50 pode destacar os benefícios dessa tecnologia para a educação, especialmente na melhoria da qualidade e do acesso ao aprendizado online. Segundo estimativas da Grand View Research, esse setor tem previsão de crescimento para US$ 348 bilhões até 2030, quase triplicando em relação a 2022.

O CS50 começou como uma única aula introdutória de computação e, ao longo do tempo, evoluiu para várias disciplinas, alcançando mais de 1,4 milhão de inscritos no YouTube e oferecendo produtos com a marca do curso, como bolas antiestresse e camisetas. Ao longo dos anos, mais de 4,7 milhões de pessoas se inscreveram no curso. Atualmente, ele está disponível como parte da plataforma de aprendizagem digital edX, criada pela Harvard e pelo Instituto de Tecnologia de Massachusetts, que oferece cursos online de nível universitário em diversas áreas.

Alguns especialistas, no entanto, aconselham cautela no uso da inteligência artificial, uma vez que essa tecnologia ainda está em desenvolvimento e suscetível a erros. Nas últimas semanas, CEOs das principais empresas de IA, incluindo a OpenAI e a DeepMind, da Alphabet, além de outras lideranças da área de tecnologia, têm alertado sobre os riscos da IA sem controle.

Outros especialistas também alertaram sobre os riscos éticos do uso da IA na educação, especialmente no que diz respeito à coleta de dados para personalizar as aulas. Para garantir a privacidade dos alunos, as plataformas precisarão incorporar medidas de privacidade e garantir que os processos de coleta de dados sejam transparentes, afirmou Emma Taylor, analista da consultoria GlobalData, com sede em Londres.

Apesar das preocupações e desafios, o CS50 acredita no potencial capacitador da IA na educação. O curso, que começou como uma aula introdutória de computação, evoluiu para se tornar um fenômeno global, com milhões de inscritos e uma presença marcante no ambiente digital. A adoção da inteligência artificial no CS50 tem como objetivo melhorar a qualidade e o acesso ao aprendizado online, contribuindo para um setor que continua a crescer e se expandir.

Eu sempre defendi a tese de que humanos e máquinas fazem uma combinação perfeita. Neste caso, a combinação do estilo de ensino cativante de David J. Malan com o poder da inteligência artificial promete oferecer uma experiência de aprendizagem ainda mais personalizada e envolvente para os estudantes do CS50. Essa iniciativa certamente terá um impacto significativo no campo da educação online e abrirá novas possibilidades para o ensino de ciência da computação em larga escala.

😴Memórias reais sendo sobrepostas por memórias sonhadas pela IA?

Nos 2 primeiros temas explorados na Carta de hoje, está claro o quanto a IA está passando a fazer parte de nossas vidas. Mas…Olhe que perigo…Novas ferramentas de manipulação de fotos do Google e da Adobe estão fazendo com que as linhas entre memórias reais e aquelas sonhadas pela IA se confundam.

Em fevereiro deste ano, a startup Runway, mais conhecida por cocriar o Stable Diffusion, a ferramenta de IA de texto para imagem que capturou imaginações em 2022, lançou uma ferramenta que poderia mudar todo o estilo de um vídeo existente com apenas um simples prompt e, no final de março, organizou o que disse ser o primeiro festival de cinema de IA no teatro Alamo Drafthouse, em São Francisco. Foram selecionados 10 curtas-metragens de cineastas iniciantes que eram, em sua maioria, demonstrações de tecnologia. Narrativas bem construídas ficaram em segundo plano. Algumas foram surreais e, em pelo menos um caso, intencionalmente macabras.

Mas o último filme exibido provocou arrepios. Parecia que o cineasta havia deliberadamente entendido mal a tarefa, evitando o vídeo para imagens estáticas. Chamado de Infância Expandida, o “filme” de IA era uma apresentação de slides de fotos com um eco quase inaudível de narração.

O diretor Sam Lawton, um estudante de cinema de 21 anos de Nebraska, mais tarde me disse que usou o DALL-E da OpenAI para alterar as imagens. Ele montou uma série de fotos de sua infância, alimentou-as com a ferramenta de IA e deu vários comandos para expandir as imagens: preencher as bordas com mais vacas, ou árvores; inserir no quadro pessoas que realmente não estiveram lá; para reimaginar como era a cozinha. Jogue outro filhote na banheira – por que não? Lawton mostrou as imagens geradas pela IA para seu pai, gravou suas reações confusas e inseriu o áudio no filme.

“Não, essa não é a nossa casa. Uau, espere um minuto. Essa é a nossa casa. Algo está errado. Não sei o que é isso. Será que eu simplesmente não me lembro?” O pai de Lawton pode ser ouvido dizendo.

Onde terminam as memórias reais e começa a IA generativa? É uma questão para a era da IA, onde nossas fotos sagradas podem se fundir com memórias “fake”, construídas a partir de novos pixels gerados inteiros pela inteligência artificial.

Nas últimas semanas, os gigantes da tecnologia Google e Adobe, cujas ferramentas coletivamente atingem bilhões de dedos, lançaram ferramentas de edição alimentadas por IA que mudam completamente o contexto das imagens, ultrapassando os limites da verdade, memória e fotografia aprimorada.

O Google mergulhou os pés na água com o lançamento de Magic Eraser em 2021. Agora, a empresa está testando o Magic Editor, um recurso em telefones Android selecionados que reposiciona assuntos, remove foto bombardeiros e edita outros elementos indecorosos e, em seguida, usa IA generativa para preencher lacunas de pixel. A Adobe, indiscutivelmente a fabricante mais famosa de software de edição criativa, anunciou no início desta semana que estava colocando seu mecanismo de IA generativo Firefly no Adobe Photoshop. O recurso de Preenchimento Gerativo editará fotos e inserirá novo conteúdo por meio de um prompt baseado em texto. Digite “adicionar algumas nuvens” e lá elas aparecem.

A Adobe está chamando-o de “copiloto” para fluxos de trabalho criativos, termo que outras empresas de tecnologia, como a Microsoft, também estão usando para descrever aplicativos de IA generativos. Por ora, pelo menos, você ainda está no controle total, tendo a IA como assistente, assumindo a navegação quando você precisa de uma pausa no banheiro. Mas talvez isto já seja um equívoco, a partir do instante que a IA passa a agir como um cartógrafo, redesenhando os mapas de sua existência.

“Torne suas memórias perfeitas” é talvez a frase mais assombrosa que já li, tuitou a presidente da Signal Foundation e ex-Googler Meredith Whittaker em fevereiro, em resposta ao anúncio do Google de que sua ferramenta Magic Eraser ficaria disponível para uma gama maior de telefones. Em sua comercialização da ferramenta, o Google mostra uma imagem de uma jovem enfrentando um mar agitado. Mais perto da costa está uma família de quatro pessoas, presumivelmente não a dela. Magic Eraser faz com que eles desapareçam.

Em nossa história, sempre podíamos editar fotos. Seja por tesoura, navalha ou tinta, desde que a foto impressa passou a existir, nós a editamos. Com a chegada do Photoshop em 1990, no computador pessoal, tudo mudou… “Jennifer in Paradise” foi a foto digital mais vista em todo o mundo: uma imagem da esposa do cocriador do Photoshop, John Knoll, sentada em uma praia em Bora Bora. Em demos, Knoll delineava sua esposa usando a agora famosa ferramenta de laço e, em seguida, a clonava. Copiou, colou, encolheu e difundiu uma ilha ao longe. “Uma ilha duplicada!” Knoll disse em um vídeo postado no canal da Adobe no YouTube em 2010. Uma ilha que não estava realmente lá. Uma massa de terra fabricada.

O que é diferente hoje – o que a IA generativa está ultrapassando limites – é a velocidade com que essas edições podem ser feitas e quem pode fazê-las. “As ferramentas de edição existem há muito tempo”, diz Shimrit Ben-Yair, chefe do Google Fotos. “E, obviamente, temos oferecido ferramentas de edição no Fotos há algum tempo. À medida que essas plataformas aumentaram suas bases de usuários, essas ferramentas se tornaram muito mais acessíveis e disponíveis para as pessoas. E imagens editadas se tornam mais comuns.”

Uma demonstração inicial da ferramenta Magic Eraser do Google apresenta duas crianças usando roupas de mergulho e pranchas de boogie, com dois adultos ao fundo distante. As crianças e os adultos têm tons de pele diferentes, e a suposição um tanto desconfortável nesta demo – também enfatizada pela distância entre eles – é que eles não são família. O Magic Eraser do Google delineou os adultos ao fundo, depois os desapareceu.

Em uma demonstração mais recente, o Magic Editor, que será lançado no final deste ano, apagou a alça da bolsa do ombro de uma mulher enquanto ela posava em frente a uma cachoeira e, em seguida, preencheu as lacunas com mais material de jaqueta. Porque a alça da bolsa em uma foto de caminhada era tão incômoda, não sei. Mas essas decisões estéticas são prerrogativa do criador da foto, diz o Google.

O Generative Fill da Adobe é muito mais generativo. Um cão de pelos longos caminha por uma estrada vazia. É isso, essa é a foto. Mas este recurso alonga o caminho, transforma árvores estéreis em flores da primavera. Uma caminhonete branca aparece, e se ela está dirigindo em direção ao cão ou longe dele muda a tensão da foto de uma maneira notável. Mas, olha, agora tem poça. Certamente essa é uma foto feliz? A IA generativa é até inteligente o suficiente para elaborar um reflexo do filhote nas poças. Ele faz tudo isso em segundos, o que impressiona.

Mas depois do espanto vem “E agora?” Suponha que seja minha foto de caminhada, meu cachorro, minha família na praia. Como vou me lembrar desse dia se no futuro eles são apenas aquarela no meu cérebro, e eu cada vez mais recorro ao meu rolo de fotos para traços mais vívidos? Eu realmente não carreguei uma bolsa durante a caminhada? A caminhonete chegou perigosamente perto do meu cachorro naquele dia? Eu só passei férias em praias imaculadas e privadas?

Executivos do Google e da Adobe dizem que o poder das ferramentas deve ser considerado dentro do contexto da foto. Quem está levando, quem está compartilhando, para onde está sendo compartilhado. “Acho que, no contexto de um espaço público, há expectativas diferentes de uma foto ser compartilhada em um espaço privado”, diz Ben-Yair. “Se alguém está compartilhando uma foto com você por meio do próprio Google Fotos ou de um aplicativo de mensagens que você usa, você confia nessa fonte. E você pode ver a edição como algo que melhora a foto, porque você confia nessa fonte.”

“Mas quanto mais camadas de abstração houver”, ela continua, “onde você não sabe a fonte, então sim, você tem que pensar, quão autêntica é essa foto?”

Da mesma forma, Andy Parsons, da Adobe, diz que há um “continuum de casos de uso” para fotos editadas por IA. Um artista (ou indivíduo que se fantasia de artista) pode usar IA generativa para alterar uma foto que deve ser uma interpretação criativa, não documentação. Por outro lado, “se é muito importante saber que o que está sendo apresentado na foto é um reflexo da realidade, como em uma organização de notícias, esperamos ver cada vez mais fotógrafos sendo obrigados a fornecer transparência”, diz Parsons.

Parsons é algo como o rei da proveniência na Adobe. Seu cargo atual é diretor sênior da Content Authenticity Initiative, um grupo que a Adobe cocriou em 2019 para estabelecer diretrizes intersetoriais sobre originação de conteúdo e transparência de mídia. Foi o vídeo manipulado de Nancy Pelosi, diz Parsons, em que a presidente da Câmara parecia estar a proferir as suas palavras, que “mais uma vez, mudou a história”. Mesmo que a edição não tenha sido creditada à IA, a pura manipulação do vídeo de Pelosi fez a Adobe reconsiderar como suas poderosas ferramentas de edição poderiam ser usadas. Os primeiros parceiros da Adobe no CAI foram o Twitter e o The New York Times. A Coalizão agora tem mais de mil membros em vários setores.

Então, em 2021, a Adobe uniu forças com a BBC, as fabricantes de chips Intel e ARM e a Microsoft para criar mais um consórcio para padrões em torno da “proveniência digital”, chamado “Coalition for Content Provenance and Authenticity”, ou C2PA. Na recente conferência anual de software da Microsoft, a empresa disse que seu Bing Image Creator em breve usará métodos criptográficos padrão C2PA para assinar conteúdo gerado por IA. (Ben-Yair, do Google, também diz que esta é uma “área ativa de trabalho para a empresa que explicaremos quando nos aproximarmos do lançamento dela.”)

“Estamos todos focados na mesma ideia”, diz Parsons. “Nós meio que perdemos a corrida armamentista em detectar o que pode ser falso. O abismo foi ultrapassado. Então, a proteção e contramedida que temos é saber qual modelo foi usado para capturar ou criar uma imagem e tornar esses metadados confiáveis.”

Em teoria, esses padrões criptográficos garantem que, se um fotógrafo profissional tirar uma foto para, digamos, a Reuters e essa foto for distribuída pelos canais de notícias internacionais da Reuters, tanto os editores que encomendam a foto quanto os consumidores que a visualizam teriam acesso a um histórico completo de dados de procedência. Eles saberão se as sombras foram perfuradas, se os carros da polícia foram removidos, se alguém foi cortado do quadro. Elementos de fotos que, de acordo com Parsons, você gostaria de ser criptograficamente prováveis e verificáveis.

Claro, tudo isso se baseia na noção de que nós – as pessoas que olhamos para fotos – vamos querer, ou nos importar ou saber como verificar, a autenticidade de uma foto. Pressupõe que somos capazes de distinguir entre social e cultura e notícias, e que essas categorias são claramente definidas.

Lembra-se da imagem “Balenciaga Pope”? A imagem do Papa Francisco usando uma jaqueta estilosa foi postada pela primeira vez no subreddit r/Midjourney como uma espécie de meme, espalhada entre os usuários do Twitter e depois captada por veículos de notícias que relatam a viralidade e as implicações da imagem gerada pela IA. Arte, social, notícias – todos foram igualmente abençoados pelo Papa. Agora sabemos que é falso, mas a Balenciaga Pope viverá para sempre em nossos cérebros.

Depois de ver o Magic Editor, tentei articular algo a Shimrit Ben-Yair sem atribuir um valor moral a ele, o que significa que prefaciei minha declaração com: “Estou tentando não atribuir um valor moral a isso”. É notável, eu disse, quanto controle de nossas memórias futuras está nas mãos de empresas gigantes de tecnologia agora simplesmente por causa das ferramentas e infraestrutura que existem para registrar grande parte de nossas vidas.

Ben-Yair fez uma pausa de cinco segundos antes de responder. “Sim, quero dizer… Acho que as pessoas confiam no Google com seus dados para proteger. E vejo isso como uma responsabilidade muito, muito grande para carregarmos.” Foi uma resposta esquecível, mas, felizmente, eu estava gravando. Em um aplicativo do Google.

Este artigo é uma grande reflexão para a nova realidade metaversica que, a cada dia, estamos mais inseridos. Mas seja no mundo físico, seja no mundo digital, ninguém quer ser enganado. Concorda comigo?

Fonte: https://www.wired.com/story/where-memory-ends-and-generative-ai-begins

🛩🔈Jato hipersônico movido a hidrogênio reduz viagem dos EUA para a Austrália de 17 horas para 4, numa velocidade 5 vezes mais rápida que o som

Uma empresa desenvolveu um jato hipersônico movido a hidrogênio que poderia reduzir o tempo de voo dos Estados Unidos para a Austrália para menos de quatro horas😱. A startup europeia Destinus testou um protótipo nos últimos anos e completou com sucesso um voo de teste no final de 2022. O jato hipersônico atinge uma velocidade de 3.700 mph e poderia voar dos Estados Unidos para a Austrália em menos de quatro horas. A aeronave seria equipada com motores turbojato movidos a hidrogênio. A Destinus, sediada na Suíça, foi fundada pelo físico e empresário russo Mikhail Kokorich.

Segundo a Destinus, seus aviões hipersônicos reduzem o tempo de transporte intercontinental de maneira significativa, graças à velocidade e capacidade de longo alcance habilitadas pelo uso do hidrogênio como combustível. Isso abriria novas rotas de voo para o transporte de passageiros e cargas em todo o mundo. O jato movido a hidrogênio é capaz de viajar a uma velocidade cinco vezes maior que o som, ou seja, Mach 5, enquanto o Concorde, para efeito de comparação, voava a uma velocidade de Mach 2.

A aeronave utilizaria motores turbo jato movidos a hidrogênio para decolagem e pouso. A Destinus afirma que o jato seria neutro em carbono, emitindo apenas calor e vapor de água. A primeira aeronave da empresa teria capacidade para 25 passageiros e é esperado que esteja pronta até 2030. No futuro, eles planejam aumentar a capacidade para até 100 passageiros a bordo.

A Destinus não é a única empresa de aviação a revelar projetos para jatos supersônicos no futuro. O Hyper Sting é um avião conceito que poderia levar passageiros de Londres para Nova York em apenas 80 minutos em um futuro próximo, viajando a uma velocidade de 2.486 mph, o dobro da velocidade do Concorde.

Fonte: https://www.the-sun.com/tech/8222575/hypersonic-hydrogen-powered-jet-destinus-australia-flight-time/

😎 Conheça o mais novo lançamento da Apple: o Vision Pro

E o assunto destes últimos dias é o lançamento do óculos de realidade virtual e mista da Apple, o “Vision Pro”. Será que ele vai realmente se tornar um importante elemento em nossa imersão de um metaverso ideal, quando os mundos físico e virtual se confundem? Ou ainda será mais um “gadget” para os videogames e plataformas gameficadas? Saiba os resultados dos primeiros testes realizados por Nilay Patel, editor-chefe do The Verge, apresentador do podcast Decoder e co-apresentador do The Vergecast:

Eu usei o Apple Vision Pro. É a melhor demonstração de óculos de VR de todos os tempos. Acabei de sair de uma longa sessão de demonstração com o novo Vision Pro de US$ 3.499 da Apple, que a empresa anunciou na WWDC 2023 como “o dispositivo eletrônico de consumo mais avançado do mundo”. É… são óculos de VR fantásticos com vídeo e telas impressionantes. E fiquei feliz usando meu telefone para fazer anotações enquanto usava o Vision Pro, algo que nenhum outro óculos até hoje permitiu.

Dito isso, embora a Apple obviamente prefira que as pessoas pensem no Vision Pro como um “poderoso computador espacial” ou um dispositivo de realidade aumentada, realmente não há como contornar a natureza essencial dos óculos de VR da coisa, até as alças ajustáveis que definitivamente bagunçaram meu cabelo. Ele parece, sente e se comporta como óculos VR. Se você usou um Meta Quest, imagine o melhor Meta Quest possível rodando algo muito parecido com o iPadOS, e você irá conseguir!

A Apple realizou demonstrações do Vision Pro em um grande edifício branco em forma de cubo que construiu para a WWDC chamado Fieldhouse. Ao entrar, recebi um iPhone para um rápido processo de configuração: uma varredura de virar o rosto em um círculo (muito parecida com a configuração do Face ID que determinava o tamanho da máscara facial a ser usada) e, em seguida, outra varredura facial de lado a lado que olhava para meus ouvidos para calibrar o áudio espacial. Depois disso, a Apple me fez visitar um “especialista em visão” que perguntou se eu usava óculos – eu estava usando meus contatos, mas os usuários de óculos tinham uma verificação rápida de prescrição para que a Apple pudesse encaixar os Vision Pros com as lentes apropriadas. (As lentes são feitas pela Zeiss; A Apple precisava de um parceiro que pudesse vender legalmente lentes de grau. Eles se encaixam magneticamente e serão vendidos separadamente no lançamento.)

O fone de ouvido em si pesa um pouco menos de um quilo – ele é conectado por um cabo de energia branco trançado a uma bateria prateada que oferece cerca de duas horas de uso. O cabo se desprende do fone de ouvido com uma trava mecânica, mas está permanentemente conectado à bateria. Se você quiser conectar à parede, conecte um adaptador USB-C à bateria.

O design é todo em alumínio escovado, vidro brilhante e tecidos macios; a vibe está mais próxima do iPhone 6 do que do iPhone 14. Esse vidro na frente é uma peça obviamente complexa de engenharia óptica: é perfeitamente curvo, mas ainda serve como uma lente apropriada para as câmeras e a tela OLED que mostra seus olhos quando você está olhando para as pessoas. (Este recurso é chamado de EyeSight; Eu não cheguei a tentar de forma alguma.)

Ao redor do óculos em si, você contará 12 câmeras, um sensor LIDAR e uma câmera TrueDepth, bem como iluminadores de inundação IR para garantir que as câmeras possam ver suas mãos em ambientes escuros para fins de controle. A coisa toda funciona em uma combinação de processadores M2 da Apple e novos processadores R1, que sem surpresa geram uma boa quantidade de calor. O Vision Pro ventila esse calor puxando o ar para cima através da parte inferior do dispositivo e ventilando-o para fora da parte superior.

A parte superior do Vision Pro tem um botão à esquerda que serve como um botão do obturador para tirar vídeos e fotos 3D, que eu não consegui experimentar. A Coroa Digital está à direita; clicar nele traz a tela inicial dos ícones do aplicativo, enquanto o gira altera o nível de imersão em RV em certos modos. Perguntei por que alguém gostaria de definir o nível de imersão em qualquer lugar que não seja all-on ou all-off, e parece que a Apple está pensando na configuração de imersão intermediária como uma espécie de espaço de trabalho ajustável para aplicativos, deixando as laterais abertas para você conversar com seus colegas.

Quando você coloca o dispositivo, há um ajuste automático rápido dos olhos que é muito mais rápido e contínuo do que em algo como o Quest Pro – não há mostradores manuais ou controles deslizantes para configurações de olhos. A Apple não disse nada específico sobre seu campo de visão muito antes do lançamento, mas eu definitivamente vi preto na minha visão periférica. O Vision Pro não é tão imersivo quanto os vídeos de marketing querem fazer você acreditar.

A tela em si é absolutamente incrível: uma tela 4K para cada olho, com pixels de apenas 23 mícrons de tamanho. No pouco tempo que experimentei, era totalmente viável para ler texto no Safari (carreguei o The Verge, claro), ver fotos e assistir filmes. É facilmente a tela VR de maior resolução que eu já vi. Havia algumas listras verdes e roxas ao redor das bordas das lentes, mas não posso dizer com certeza se isso se deveu ao ajuste rápido ou à natureza de demonstração inicial do dispositivo ou algo totalmente diferente. Teremos que ver quando ele realmente será enviado.

A passagem do vídeo foi igualmente impressionante. Apareceu com latência zero e era nítido, nítido e claro. Conversei alegremente com outras pessoas, andei pela sala e até tomei notas no meu telefone enquanto usava o fone de ouvido – algo que eu nunca seria capaz de fazer com algo como o Meta Quest Pro. Dito isso, ainda é passagem de vídeo. Eu podia ver uma compressão bastante intensa às vezes, e perda de detalhes quando os rostos das pessoas se moviam para sombras. Eu podia ver a luz IR na frente do meu iPhone piscar inutilmente enquanto tentava desbloquear com o FaceID sem sucesso. E a tela era mais fraca do que a sala em si, então quando tirei o fone de ouvido meus olhos tive que se ajustar ao quão mais brilhante a sala era na realidade.

Da mesma forma, a capacidade da Apple de fazer realidade mista é impressionante. Em um ponto em uma demonstração completa de VR Avatar eu levantei minhas mãos para gesticular em algo, e o fone de ouvido detectou automaticamente minhas mãos e as sobrepôs na tela, então notei que eu estava falando com alguém e as fiz aparecer também. Leitor, eu engasguei. A Apple também foi muito mais longe com o rastreamento ocular e o controle por gestos: o rastreamento ocular era bastante sólido, e esses iluminadores IR e câmeras laterais significam que você pode tocar o polegar e o indicador juntos para selecionar as coisas enquanto elas estão no colo ou ao lado. Você não precisa estar apontando para nada. É muito legal.

A Apple claramente resolveu um monte de grandes problemas de interação de hardware com óculos de VR, principalmente superando a engenharia e gastando mais do que todos os outros que tentaram. Mas ainda não respondeu à pergunta sobre para que servem essas coisas: a interface principal é muito mais uma grade de ícones, e a maioria das demos eram basicamente projeções de telas gigantes com aplicativos muito familiares. Safári. Fotos. Filmes. O aplicativo de colaboração Freeform. Videochamadas FaceTime. Houve uma demonstração com dinossauros 3D onde uma borboleta pousou na minha mão estendida, mas isso foi tanto “realidade aumentada” quanto eu realmente experimentei. (Sim, mapear a sala e projetar as telas é um trabalho de RA muito complexo, mas não havia tanto quanto um aplicativo de medição de coisas depois de anos de demonstrações ARKit na WWDC. Foi estranho.)

Eu consegui ver uma rápida chamada do FaceTime com outra pessoa em um Vision Pro usando uma “persona” 3D gerada por IA (a Apple não gosta quando você os chama de “avatares”), o que foi impressionante e profundamente estranho. Era imediatamente óbvio que eu estava falando com uma persona de uma maneira estranha, especialmente porque a maior parte do rosto da pessoa estava congelada além de sua boca e olhos. Mas mesmo isso foi convincente depois de um tempo, e certamente muito mais agradável do que sua chamada média do Zoom. Você montou uma persona segurando o fone de ouvido na sua frente e deixando que ele escaneasse seu rosto, mas eu não fui capaz de configurar um sozinho e claramente há muito refinamento ainda por vir, então vou reter o julgamento até mais tarde.

Tudo isso foi basicamente um grande sucesso das demonstrações de VR, incluindo alguns standbys antigos: a Apple mostrou vídeos 180D de 3 graus com áudio espacial em algo chamado Apple Immersive Video Format, que a empresa aparentemente filmou com câmeras proprietárias que pode ou não lançar. (Eles se pareciam com os vídeos 3D que vemos em demonstrações de RV desde sempre.) Eu olhei para uma foto 3D de algumas crianças fofas tiradas pelas câmeras do fone de ouvido e assisti a um vídeo 3D dessas crianças soprando uma vela de aniversário. (Mesmo.) Fiz uma meditação Mindfulness de um minuto em que uma voz me ordenou a ser grata enquanto a sala escurecia e uma esfera de triângulos coloridos se expandia ao meu redor. (Isso parecia ótimo, mas Supernatural existe, tem milhões de usuários na Quest e oferece meditação guiada desde 2020.) E eu assisti Avatar no que parecia ser uma sala de cinema, que, bem, essa é uma das demos de realidade virtual mais antigas de todos os tempos.

Tudo isso foi melhorado pelo hardware Vision Pro extremamente superior? Sem dúvida. Mas tornou-se mais convincente? Eu não sei, e não tenho certeza se posso saber com apenas um curto período usando o dispositivo. Eu sei que usar essa coisa parecia estranhamente solitário. Como você assiste a um filme com outras pessoas em um Vision Pro? E se você quiser colaborar com as pessoas na sala com você e as pessoas no FaceTime? O que significa que a Apple quer que você use um fone de ouvido na festa de aniversário do seu filho? Há apenas mais perguntas do que respostas aqui, e algumas dessas perguntas atingem a própria natureza do que significa para nossas vidas serem literalmente mediadas por telas.

Também sei que a Apple ainda tem uma longa lista de coisas que quer refinar entre agora e o próximo ano, quando o Vision Pro for lançado. Essa é parte da razão pela qual está sendo anunciado na WWDC: para permitir que os desenvolvedores reajam a isso, descobrir que tipos de aplicativos eles podem criar e começar a usá-los. Mas essa é a mesma promessa que ouvimos sobre óculos de realidade virtual há anos, da Meta e de outros. A Apple pode claramente superar todos na indústria quando se trata de hardware, especialmente quando o custo aparentemente não é objeto. Mas o rolo de demonstração de fone de ouvido mais perfeito de todos os tempos ainda é apenas um rolo de demonstração de óculos de VR – se a famosa comunidade de desenvolvedores da Apple pode gerar um aplicativo matador para o Vision Pro ainda está no ar.

A Carta do Especialista de hoje foi escrita por Inteligência Artificial. Ou não? Como saber a diferença, em tempos que robôs de jardinagem estão passando pelo Teste de Turing e a IA está passando a ser a estrela principal dos cursos de computação de Harvard? E não como matéria e sim como na função de professora! Se para você estes argumentos não forem suficientes, chegamos a um momento que a linha entre nossas memórias reais e aquelas sonhadas por uma IA, está ficando borrada…Sim…Um perigo…E, como tudo está indo numa velocidade exponencial, conheça o novo avião que pode viajar numa velocidade 5 vezes maior do que o som, reduzindo o tempo de viagem entre EUA e Australia, de 17 para 4 horas. E finalizo a Carta com uma análise do lançamento dos óculos de realidade virtual e mista da Apple, que talvez nos faça avançar mais um passo na jornada de busca de um Metaverso ideal.

🤖Robôs de Jardinagem passam no Teste de Turing

Na Carta do Especialista da semana passada (Clique aqui para ler), focada em IA, comentei a respeito do Teste de Turing, desenvolvido em 1950 por Alan Turing, que levantou a questão “Máquinas podem pensar?” propondo um teste baseado na comparação entre a capacidade humana e a capacidade da máquina em responder perguntas.

Começo a Carta de hoje aproveitando a este link e adaptando a pergunta para as “Máquinas podem jardinar?”, através da comparação entre a habilidade humana e de uma máquina em cuidar de um jardim de policultura real.

A Universidade da Califórnia, Berkeley, tem uma longa história de pesquisa em jardins robóticos, que remonta ao início dos anos 90, quando já cuidavam de um jardim inteiro com a ajuda de um robô. Contudo, a verdadeira questão hoje é: o robô pode cuidar de um jardim de forma tão eficaz quanto um humano? Vamos agora adentrar o campo da CIÊNCIA! 👏

Diretamente de Berkeley, um avançado robô chamado AlphaGarden, com habilidades superiores às de um jardineiro profissional, está redefinindo os cuidados com as plantas. Esses robôs não são sofisticados; são sistemas hidropônicos automatizados que controlam a água, os nutrientes e até mesmo a luz solar simulada. Eles fazem um trabalho incrível gerando evidências de que os jardineiros robóticos podem ser tão eficientes quanto os melhores jardineiros humanos e, em alguns aspectos, até superá-los.

O AlphaGarden é uma combinação de um sistema de cultivo robótico em um pórtico comercial e o AlphaGardenSim, um software desenvolvido pela UC Berkeley que instrui o robô sobre como maximizar a saúde e o crescimento das plantas. O sistema inclui uma câmera de alta resolução e sensores de umidade do solo para monitorar o crescimento das plantas. Tudo é automatizado, desde o plantio de sementes até a irrigação por gotejamento e a poda. O jardim em si é complexo, sendo um jardim de policultura, onde diferentes plantas coexistem. Esse tipo de cultivo imita o crescimento natural das plantas e traz benefícios como a resistência a pragas, a redução da necessidade de adubação e a melhoria da saúde do solo. No entanto, a policultura requer mais trabalho manual do que a monocultura, que é o método predominante na agricultura em larga escala.

Para avaliar o desempenho do AlphaGarden, os pesquisadores da UC Berkeley realizaram um experimento. Eles plantaram duas áreas agrícolas lado a lado, utilizando as mesmas sementes. Ao longo de dois meses, o AlphaGarden cuidou de uma das áreas em tempo integral, enquanto jardineiros profissionais cuidaram da outra área. Em um segundo teste, o AlphaGarden teve permissão para plantar as sementes em diferentes momentos, dando uma vantagem inicial às plantas de crescimento mais lento. Durante o experimento, um ser humano precisou ajudar o robô ocasionalmente com a poda, seguindo as instruções fornecidas pelo próprio robô quando a ferramenta de poda não conseguia realizar determinadas tarefas.

Os resultados desses testes mostraram que o robô alcançou resultados semelhantes ao jardineiro profissional em termos de diversidade e cobertura das plantas. Em outras palavras, as plantas cresceram tão bem com os cuidados do robô quanto com os cuidados de um jardineiro humano experiente. A diferença significativa foi que o robô conseguiu realizar a tarefa com um consumo de água 44% menor, economizando centenas de litros em apenas dois meses.

O futuro desse campo ainda é incerto, uma vez que o custo do hardware é elevado, enquanto a mão de obra humana é relativamente mais acessível. No entanto, para aqueles de nós que não são especialistas em jardinagem, é fácil imaginar a instalação de câmeras e sensores em nossos jardins, seguido as orientações de um simulador sobre quando e onde regar e podar. Estou sempre disposto a ceder o trabalho para um robô que sabe fazer melhor do que eu. 😅’ E você?

Fonte: https://spectrum.ieee.org/robot-gardener

🖥Professor de Harvard aproveita IA para ajudar a dar a aula de computação

O CS50, o curso de ciência da computação mais popular do mundo, oferecido pela Universidade de Harvard, está passando por uma transformação na era do ChatGPT. O professor David J. Malan, responsável pelo curso, planeja utilizar inteligência artificial para avaliar tarefas, ensinar programação e fornecer dicas personalizadas de aprendizagem.

O estilo de ensino enérgico e envolvente de Malan tem sido elogiado por transformar palestras monótonas e básicas sobre os fundamentos do desenvolvimento web e programação de software em aulas divertidas, repletas de exercícios interativos. No entanto, com o crescente número de alunos conectados de fusos horários diferentes e com diferentes níveis de conhecimento e experiência, tornou-se desafiador oferecer suporte individualizado às perguntas específicas dos alunos.

Para lidar com esse desafio em grande escala, a equipe do CS50 está desenvolvendo um sistema de inteligência artificial para avaliar o trabalho dos alunos e testando um assistente de ensino virtual para avaliar e fornecer feedback sobre a programação dos estudantes. O assistente virtual faz perguntas retóricas e oferece sugestões para auxiliar no aprendizado, em vez de simplesmente detectar erros e corrigir bugs de programação. A ideia é que, a longo prazo, isso permita que os assistentes de ensino humanos tenham mais tempo para interagir presencialmente ou por meio de videochamadas.

Essa iniciativa ocorre em um momento em que os educadores estão preocupados com o fato de que tecnologias como o ChatGPT possam facilitar a trapaça e a plágio por parte dos alunos, sem serem detectados. Algumas escolas e universidades em todo o mundo já proibiram o uso desse tipo de ferramenta. Além disso, o avanço da inteligência artificial também afetou as ações de empresas de educação online, como a Chegg Inc., que recentemente registrou uma desaceleração no crescimento de assinantes à medida que as pessoas experimentam o chatbot gratuito desenvolvido pela OpenAI.

No entanto, Malan argumenta que o uso da inteligência artificial pelo CS50 pode destacar os benefícios dessa tecnologia para a educação, especialmente na melhoria da qualidade e do acesso ao aprendizado online. Segundo estimativas da Grand View Research, esse setor tem previsão de crescimento para US$ 348 bilhões até 2030, quase triplicando em relação a 2022.

O CS50 começou como uma única aula introdutória de computação e, ao longo do tempo, evoluiu para várias disciplinas, alcançando mais de 1,4 milhão de inscritos no YouTube e oferecendo produtos com a marca do curso, como bolas antiestresse e camisetas. Ao longo dos anos, mais de 4,7 milhões de pessoas se inscreveram no curso. Atualmente, ele está disponível como parte da plataforma de aprendizagem digital edX, criada pela Harvard e pelo Instituto de Tecnologia de Massachusetts, que oferece cursos online de nível universitário em diversas áreas.

Alguns especialistas, no entanto, aconselham cautela no uso da inteligência artificial, uma vez que essa tecnologia ainda está em desenvolvimento e suscetível a erros. Nas últimas semanas, CEOs das principais empresas de IA, incluindo a OpenAI e a DeepMind, da Alphabet, além de outras lideranças da área de tecnologia, têm alertado sobre os riscos da IA sem controle.

Outros especialistas também alertaram sobre os riscos éticos do uso da IA na educação, especialmente no que diz respeito à coleta de dados para personalizar as aulas. Para garantir a privacidade dos alunos, as plataformas precisarão incorporar medidas de privacidade e garantir que os processos de coleta de dados sejam transparentes, afirmou Emma Taylor, analista da consultoria GlobalData, com sede em Londres.

Apesar das preocupações e desafios, o CS50 acredita no potencial capacitador da IA na educação. O curso, que começou como uma aula introdutória de computação, evoluiu para se tornar um fenômeno global, com milhões de inscritos e uma presença marcante no ambiente digital. A adoção da inteligência artificial no CS50 tem como objetivo melhorar a qualidade e o acesso ao aprendizado online, contribuindo para um setor que continua a crescer e se expandir.

Eu sempre defendi a tese de que humanos e máquinas fazem uma combinação perfeita. Neste caso, a combinação do estilo de ensino cativante de David J. Malan com o poder da inteligência artificial promete oferecer uma experiência de aprendizagem ainda mais personalizada e envolvente para os estudantes do CS50. Essa iniciativa certamente terá um impacto significativo no campo da educação online e abrirá novas possibilidades para o ensino de ciência da computação em larga escala.

😴Memórias reais sendo sobrepostas por memórias sonhadas pela IA?

Nos 2 primeiros temas explorados na Carta de hoje, está claro o quanto a IA está passando a fazer parte de nossas vidas. Mas…Olhe que perigo…Novas ferramentas de manipulação de fotos do Google e da Adobe estão fazendo com que as linhas entre memórias reais e aquelas sonhadas pela IA se confundam.

Em fevereiro deste ano, a startup Runway, mais conhecida por cocriar o Stable Diffusion, a ferramenta de IA de texto para imagem que capturou imaginações em 2022, lançou uma ferramenta que poderia mudar todo o estilo de um vídeo existente com apenas um simples prompt e, no final de março, organizou o que disse ser o primeiro festival de cinema de IA no teatro Alamo Drafthouse, em São Francisco. Foram selecionados 10 curtas-metragens de cineastas iniciantes que eram, em sua maioria, demonstrações de tecnologia. Narrativas bem construídas ficaram em segundo plano. Algumas foram surreais e, em pelo menos um caso, intencionalmente macabras.

Mas o último filme exibido provocou arrepios. Parecia que o cineasta havia deliberadamente entendido mal a tarefa, evitando o vídeo para imagens estáticas. Chamado de Infância Expandida, o “filme” de IA era uma apresentação de slides de fotos com um eco quase inaudível de narração.

O diretor Sam Lawton, um estudante de cinema de 21 anos de Nebraska, mais tarde me disse que usou o DALL-E da OpenAI para alterar as imagens. Ele montou uma série de fotos de sua infância, alimentou-as com a ferramenta de IA e deu vários comandos para expandir as imagens: preencher as bordas com mais vacas, ou árvores; inserir no quadro pessoas que realmente não estiveram lá; para reimaginar como era a cozinha. Jogue outro filhote na banheira – por que não? Lawton mostrou as imagens geradas pela IA para seu pai, gravou suas reações confusas e inseriu o áudio no filme.

“Não, essa não é a nossa casa. Uau, espere um minuto. Essa é a nossa casa. Algo está errado. Não sei o que é isso. Será que eu simplesmente não me lembro?” O pai de Lawton pode ser ouvido dizendo.

Onde terminam as memórias reais e começa a IA generativa? É uma questão para a era da IA, onde nossas fotos sagradas podem se fundir com memórias “fake”, construídas a partir de novos pixels gerados inteiros pela inteligência artificial.

Nas últimas semanas, os gigantes da tecnologia Google e Adobe, cujas ferramentas coletivamente atingem bilhões de dedos, lançaram ferramentas de edição alimentadas por IA que mudam completamente o contexto das imagens, ultrapassando os limites da verdade, memória e fotografia aprimorada.

O Google mergulhou os pés na água com o lançamento de Magic Eraser em 2021. Agora, a empresa está testando o Magic Editor, um recurso em telefones Android selecionados que reposiciona assuntos, remove foto bombardeiros e edita outros elementos indecorosos e, em seguida, usa IA generativa para preencher lacunas de pixel. A Adobe, indiscutivelmente a fabricante mais famosa de software de edição criativa, anunciou no início desta semana que estava colocando seu mecanismo de IA generativo Firefly no Adobe Photoshop. O recurso de Preenchimento Gerativo editará fotos e inserirá novo conteúdo por meio de um prompt baseado em texto. Digite “adicionar algumas nuvens” e lá elas aparecem.

A Adobe está chamando-o de “copiloto” para fluxos de trabalho criativos, termo que outras empresas de tecnologia, como a Microsoft, também estão usando para descrever aplicativos de IA generativos. Por ora, pelo menos, você ainda está no controle total, tendo a IA como assistente, assumindo a navegação quando você precisa de uma pausa no banheiro. Mas talvez isto já seja um equívoco, a partir do instante que a IA passa a agir como um cartógrafo, redesenhando os mapas de sua existência.

“Torne suas memórias perfeitas” é talvez a frase mais assombrosa que já li, tuitou a presidente da Signal Foundation e ex-Googler Meredith Whittaker em fevereiro, em resposta ao anúncio do Google de que sua ferramenta Magic Eraser ficaria disponível para uma gama maior de telefones. Em sua comercialização da ferramenta, o Google mostra uma imagem de uma jovem enfrentando um mar agitado. Mais perto da costa está uma família de quatro pessoas, presumivelmente não a dela. Magic Eraser faz com que eles desapareçam.

Em nossa história, sempre podíamos editar fotos. Seja por tesoura, navalha ou tinta, desde que a foto impressa passou a existir, nós a editamos. Com a chegada do Photoshop em 1990, no computador pessoal, tudo mudou… “Jennifer in Paradise” foi a foto digital mais vista em todo o mundo: uma imagem da esposa do cocriador do Photoshop, John Knoll, sentada em uma praia em Bora Bora. Em demos, Knoll delineava sua esposa usando a agora famosa ferramenta de laço e, em seguida, a clonava. Copiou, colou, encolheu e difundiu uma ilha ao longe. “Uma ilha duplicada!” Knoll disse em um vídeo postado no canal da Adobe no YouTube em 2010. Uma ilha que não estava realmente lá. Uma massa de terra fabricada.

O que é diferente hoje – o que a IA generativa está ultrapassando limites – é a velocidade com que essas edições podem ser feitas e quem pode fazê-las. “As ferramentas de edição existem há muito tempo”, diz Shimrit Ben-Yair, chefe do Google Fotos. “E, obviamente, temos oferecido ferramentas de edição no Fotos há algum tempo. À medida que essas plataformas aumentaram suas bases de usuários, essas ferramentas se tornaram muito mais acessíveis e disponíveis para as pessoas. E imagens editadas se tornam mais comuns.”

Uma demonstração inicial da ferramenta Magic Eraser do Google apresenta duas crianças usando roupas de mergulho e pranchas de boogie, com dois adultos ao fundo distante. As crianças e os adultos têm tons de pele diferentes, e a suposição um tanto desconfortável nesta demo – também enfatizada pela distância entre eles – é que eles não são família. O Magic Eraser do Google delineou os adultos ao fundo, depois os desapareceu.

Em uma demonstração mais recente, o Magic Editor, que será lançado no final deste ano, apagou a alça da bolsa do ombro de uma mulher enquanto ela posava em frente a uma cachoeira e, em seguida, preencheu as lacunas com mais material de jaqueta. Porque a alça da bolsa em uma foto de caminhada era tão incômoda, não sei. Mas essas decisões estéticas são prerrogativa do criador da foto, diz o Google.

O Generative Fill da Adobe é muito mais generativo. Um cão de pelos longos caminha por uma estrada vazia. É isso, essa é a foto. Mas este recurso alonga o caminho, transforma árvores estéreis em flores da primavera. Uma caminhonete branca aparece, e se ela está dirigindo em direção ao cão ou longe dele muda a tensão da foto de uma maneira notável. Mas, olha, agora tem poça. Certamente essa é uma foto feliz? A IA generativa é até inteligente o suficiente para elaborar um reflexo do filhote nas poças. Ele faz tudo isso em segundos, o que impressiona.

Mas depois do espanto vem “E agora?” Suponha que seja minha foto de caminhada, meu cachorro, minha família na praia. Como vou me lembrar desse dia se no futuro eles são apenas aquarela no meu cérebro, e eu cada vez mais recorro ao meu rolo de fotos para traços mais vívidos? Eu realmente não carreguei uma bolsa durante a caminhada? A caminhonete chegou perigosamente perto do meu cachorro naquele dia? Eu só passei férias em praias imaculadas e privadas?

Executivos do Google e da Adobe dizem que o poder das ferramentas deve ser considerado dentro do contexto da foto. Quem está levando, quem está compartilhando, para onde está sendo compartilhado. “Acho que, no contexto de um espaço público, há expectativas diferentes de uma foto ser compartilhada em um espaço privado”, diz Ben-Yair. “Se alguém está compartilhando uma foto com você por meio do próprio Google Fotos ou de um aplicativo de mensagens que você usa, você confia nessa fonte. E você pode ver a edição como algo que melhora a foto, porque você confia nessa fonte.”

“Mas quanto mais camadas de abstração houver”, ela continua, “onde você não sabe a fonte, então sim, você tem que pensar, quão autêntica é essa foto?”

Da mesma forma, Andy Parsons, da Adobe, diz que há um “continuum de casos de uso” para fotos editadas por IA. Um artista (ou indivíduo que se fantasia de artista) pode usar IA generativa para alterar uma foto que deve ser uma interpretação criativa, não documentação. Por outro lado, “se é muito importante saber que o que está sendo apresentado na foto é um reflexo da realidade, como em uma organização de notícias, esperamos ver cada vez mais fotógrafos sendo obrigados a fornecer transparência”, diz Parsons.

Parsons é algo como o rei da proveniência na Adobe. Seu cargo atual é diretor sênior da Content Authenticity Initiative, um grupo que a Adobe cocriou em 2019 para estabelecer diretrizes intersetoriais sobre originação de conteúdo e transparência de mídia. Foi o vídeo manipulado de Nancy Pelosi, diz Parsons, em que a presidente da Câmara parecia estar a proferir as suas palavras, que “mais uma vez, mudou a história”. Mesmo que a edição não tenha sido creditada à IA, a pura manipulação do vídeo de Pelosi fez a Adobe reconsiderar como suas poderosas ferramentas de edição poderiam ser usadas. Os primeiros parceiros da Adobe no CAI foram o Twitter e o The New York Times. A Coalizão agora tem mais de mil membros em vários setores.

Então, em 2021, a Adobe uniu forças com a BBC, as fabricantes de chips Intel e ARM e a Microsoft para criar mais um consórcio para padrões em torno da “proveniência digital”, chamado “Coalition for Content Provenance and Authenticity”, ou C2PA. Na recente conferência anual de software da Microsoft, a empresa disse que seu Bing Image Creator em breve usará métodos criptográficos padrão C2PA para assinar conteúdo gerado por IA. (Ben-Yair, do Google, também diz que esta é uma “área ativa de trabalho para a empresa que explicaremos quando nos aproximarmos do lançamento dela.”)

“Estamos todos focados na mesma ideia”, diz Parsons. “Nós meio que perdemos a corrida armamentista em detectar o que pode ser falso. O abismo foi ultrapassado. Então, a proteção e contramedida que temos é saber qual modelo foi usado para capturar ou criar uma imagem e tornar esses metadados confiáveis.”

Em teoria, esses padrões criptográficos garantem que, se um fotógrafo profissional tirar uma foto para, digamos, a Reuters e essa foto for distribuída pelos canais de notícias internacionais da Reuters, tanto os editores que encomendam a foto quanto os consumidores que a visualizam teriam acesso a um histórico completo de dados de procedência. Eles saberão se as sombras foram perfuradas, se os carros da polícia foram removidos, se alguém foi cortado do quadro. Elementos de fotos que, de acordo com Parsons, você gostaria de ser criptograficamente prováveis e verificáveis.

Claro, tudo isso se baseia na noção de que nós – as pessoas que olhamos para fotos – vamos querer, ou nos importar ou saber como verificar, a autenticidade de uma foto. Pressupõe que somos capazes de distinguir entre social e cultura e notícias, e que essas categorias são claramente definidas.

Lembra-se da imagem “Balenciaga Pope”? A imagem do Papa Francisco usando uma jaqueta estilosa foi postada pela primeira vez no subreddit r/Midjourney como uma espécie de meme, espalhada entre os usuários do Twitter e depois captada por veículos de notícias que relatam a viralidade e as implicações da imagem gerada pela IA. Arte, social, notícias – todos foram igualmente abençoados pelo Papa. Agora sabemos que é falso, mas a Balenciaga Pope viverá para sempre em nossos cérebros.

Depois de ver o Magic Editor, tentei articular algo a Shimrit Ben-Yair sem atribuir um valor moral a ele, o que significa que prefaciei minha declaração com: “Estou tentando não atribuir um valor moral a isso”. É notável, eu disse, quanto controle de nossas memórias futuras está nas mãos de empresas gigantes de tecnologia agora simplesmente por causa das ferramentas e infraestrutura que existem para registrar grande parte de nossas vidas.

Ben-Yair fez uma pausa de cinco segundos antes de responder. “Sim, quero dizer… Acho que as pessoas confiam no Google com seus dados para proteger. E vejo isso como uma responsabilidade muito, muito grande para carregarmos.” Foi uma resposta esquecível, mas, felizmente, eu estava gravando. Em um aplicativo do Google.

Este artigo é uma grande reflexão para a nova realidade metaversica que, a cada dia, estamos mais inseridos. Mas seja no mundo físico, seja no mundo digital, ninguém quer ser enganado. Concorda comigo?

Fonte: https://www.wired.com/story/where-memory-ends-and-generative-ai-begins

🛩🔈Jato hipersônico movido a hidrogênio reduz viagem dos EUA para a Austrália de 17 horas para 4, numa velocidade 5 vezes mais rápida que o som

Uma empresa desenvolveu um jato hipersônico movido a hidrogênio que poderia reduzir o tempo de voo dos Estados Unidos para a Austrália para menos de quatro horas😱. A startup europeia Destinus testou um protótipo nos últimos anos e completou com sucesso um voo de teste no final de 2022. O jato hipersônico atinge uma velocidade de 3.700 mph e poderia voar dos Estados Unidos para a Austrália em menos de quatro horas. A aeronave seria equipada com motores turbojato movidos a hidrogênio. A Destinus, sediada na Suíça, foi fundada pelo físico e empresário russo Mikhail Kokorich.

Segundo a Destinus, seus aviões hipersônicos reduzem o tempo de transporte intercontinental de maneira significativa, graças à velocidade e capacidade de longo alcance habilitadas pelo uso do hidrogênio como combustível. Isso abriria novas rotas de voo para o transporte de passageiros e cargas em todo o mundo. O jato movido a hidrogênio é capaz de viajar a uma velocidade cinco vezes maior que o som, ou seja, Mach 5, enquanto o Concorde, para efeito de comparação, voava a uma velocidade de Mach 2.

A aeronave utilizaria motores turbo jato movidos a hidrogênio para decolagem e pouso. A Destinus afirma que o jato seria neutro em carbono, emitindo apenas calor e vapor de água. A primeira aeronave da empresa teria capacidade para 25 passageiros e é esperado que esteja pronta até 2030. No futuro, eles planejam aumentar a capacidade para até 100 passageiros a bordo.

A Destinus não é a única empresa de aviação a revelar projetos para jatos supersônicos no futuro. O Hyper Sting é um avião conceito que poderia levar passageiros de Londres para Nova York em apenas 80 minutos em um futuro próximo, viajando a uma velocidade de 2.486 mph, o dobro da velocidade do Concorde.

Fonte: https://www.the-sun.com/tech/8222575/hypersonic-hydrogen-powered-jet-destinus-australia-flight-time/

😎 Conheça o mais novo lançamento da Apple: o Vision Pro

E o assunto destes últimos dias é o lançamento do óculos de realidade virtual e mista da Apple, o “Vision Pro”. Será que ele vai realmente se tornar um importante elemento em nossa imersão de um metaverso ideal, quando os mundos físico e virtual se confundem? Ou ainda será mais um “gadget” para os videogames e plataformas gameficadas? Saiba os resultados dos primeiros testes realizados por Nilay Patel, editor-chefe do The Verge, apresentador do podcast Decoder e co-apresentador do The Vergecast:

Eu usei o Apple Vision Pro. É a melhor demonstração de óculos de VR de todos os tempos. Acabei de sair de uma longa sessão de demonstração com o novo Vision Pro de US$ 3.499 da Apple, que a empresa anunciou na WWDC 2023 como “o dispositivo eletrônico de consumo mais avançado do mundo”. É… são óculos de VR fantásticos com vídeo e telas impressionantes. E fiquei feliz usando meu telefone para fazer anotações enquanto usava o Vision Pro, algo que nenhum outro óculos até hoje permitiu.

Dito isso, embora a Apple obviamente prefira que as pessoas pensem no Vision Pro como um “poderoso computador espacial” ou um dispositivo de realidade aumentada, realmente não há como contornar a natureza essencial dos óculos de VR da coisa, até as alças ajustáveis que definitivamente bagunçaram meu cabelo. Ele parece, sente e se comporta como óculos VR. Se você usou um Meta Quest, imagine o melhor Meta Quest possível rodando algo muito parecido com o iPadOS, e você irá conseguir!

A Apple realizou demonstrações do Vision Pro em um grande edifício branco em forma de cubo que construiu para a WWDC chamado Fieldhouse. Ao entrar, recebi um iPhone para um rápido processo de configuração: uma varredura de virar o rosto em um círculo (muito parecida com a configuração do Face ID que determinava o tamanho da máscara facial a ser usada) e, em seguida, outra varredura facial de lado a lado que olhava para meus ouvidos para calibrar o áudio espacial. Depois disso, a Apple me fez visitar um “especialista em visão” que perguntou se eu usava óculos – eu estava usando meus contatos, mas os usuários de óculos tinham uma verificação rápida de prescrição para que a Apple pudesse encaixar os Vision Pros com as lentes apropriadas. (As lentes são feitas pela Zeiss; A Apple precisava de um parceiro que pudesse vender legalmente lentes de grau. Eles se encaixam magneticamente e serão vendidos separadamente no lançamento.)

O fone de ouvido em si pesa um pouco menos de um quilo – ele é conectado por um cabo de energia branco trançado a uma bateria prateada que oferece cerca de duas horas de uso. O cabo se desprende do fone de ouvido com uma trava mecânica, mas está permanentemente conectado à bateria. Se você quiser conectar à parede, conecte um adaptador USB-C à bateria.

O design é todo em alumínio escovado, vidro brilhante e tecidos macios; a vibe está mais próxima do iPhone 6 do que do iPhone 14. Esse vidro na frente é uma peça obviamente complexa de engenharia óptica: é perfeitamente curvo, mas ainda serve como uma lente apropriada para as câmeras e a tela OLED que mostra seus olhos quando você está olhando para as pessoas. (Este recurso é chamado de EyeSight; Eu não cheguei a tentar de forma alguma.)

Ao redor do óculos em si, você contará 12 câmeras, um sensor LIDAR e uma câmera TrueDepth, bem como iluminadores de inundação IR para garantir que as câmeras possam ver suas mãos em ambientes escuros para fins de controle. A coisa toda funciona em uma combinação de processadores M2 da Apple e novos processadores R1, que sem surpresa geram uma boa quantidade de calor. O Vision Pro ventila esse calor puxando o ar para cima através da parte inferior do dispositivo e ventilando-o para fora da parte superior.

A parte superior do Vision Pro tem um botão à esquerda que serve como um botão do obturador para tirar vídeos e fotos 3D, que eu não consegui experimentar. A Coroa Digital está à direita; clicar nele traz a tela inicial dos ícones do aplicativo, enquanto o gira altera o nível de imersão em RV em certos modos. Perguntei por que alguém gostaria de definir o nível de imersão em qualquer lugar que não seja all-on ou all-off, e parece que a Apple está pensando na configuração de imersão intermediária como uma espécie de espaço de trabalho ajustável para aplicativos, deixando as laterais abertas para você conversar com seus colegas.

Quando você coloca o dispositivo, há um ajuste automático rápido dos olhos que é muito mais rápido e contínuo do que em algo como o Quest Pro – não há mostradores manuais ou controles deslizantes para configurações de olhos. A Apple não disse nada específico sobre seu campo de visão muito antes do lançamento, mas eu definitivamente vi preto na minha visão periférica. O Vision Pro não é tão imersivo quanto os vídeos de marketing querem fazer você acreditar.

A tela em si é absolutamente incrível: uma tela 4K para cada olho, com pixels de apenas 23 mícrons de tamanho. No pouco tempo que experimentei, era totalmente viável para ler texto no Safari (carreguei o The Verge, claro), ver fotos e assistir filmes. É facilmente a tela VR de maior resolução que eu já vi. Havia algumas listras verdes e roxas ao redor das bordas das lentes, mas não posso dizer com certeza se isso se deveu ao ajuste rápido ou à natureza de demonstração inicial do dispositivo ou algo totalmente diferente. Teremos que ver quando ele realmente será enviado.

A passagem do vídeo foi igualmente impressionante. Apareceu com latência zero e era nítido, nítido e claro. Conversei alegremente com outras pessoas, andei pela sala e até tomei notas no meu telefone enquanto usava o fone de ouvido – algo que eu nunca seria capaz de fazer com algo como o Meta Quest Pro. Dito isso, ainda é passagem de vídeo. Eu podia ver uma compressão bastante intensa às vezes, e perda de detalhes quando os rostos das pessoas se moviam para sombras. Eu podia ver a luz IR na frente do meu iPhone piscar inutilmente enquanto tentava desbloquear com o FaceID sem sucesso. E a tela era mais fraca do que a sala em si, então quando tirei o fone de ouvido meus olhos tive que se ajustar ao quão mais brilhante a sala era na realidade.

Da mesma forma, a capacidade da Apple de fazer realidade mista é impressionante. Em um ponto em uma demonstração completa de VR Avatar eu levantei minhas mãos para gesticular em algo, e o fone de ouvido detectou automaticamente minhas mãos e as sobrepôs na tela, então notei que eu estava falando com alguém e as fiz aparecer também. Leitor, eu engasguei. A Apple também foi muito mais longe com o rastreamento ocular e o controle por gestos: o rastreamento ocular era bastante sólido, e esses iluminadores IR e câmeras laterais significam que você pode tocar o polegar e o indicador juntos para selecionar as coisas enquanto elas estão no colo ou ao lado. Você não precisa estar apontando para nada. É muito legal.

A Apple claramente resolveu um monte de grandes problemas de interação de hardware com óculos de VR, principalmente superando a engenharia e gastando mais do que todos os outros que tentaram. Mas ainda não respondeu à pergunta sobre para que servem essas coisas: a interface principal é muito mais uma grade de ícones, e a maioria das demos eram basicamente projeções de telas gigantes com aplicativos muito familiares. Safári. Fotos. Filmes. O aplicativo de colaboração Freeform. Videochamadas FaceTime. Houve uma demonstração com dinossauros 3D onde uma borboleta pousou na minha mão estendida, mas isso foi tanto “realidade aumentada” quanto eu realmente experimentei. (Sim, mapear a sala e projetar as telas é um trabalho de RA muito complexo, mas não havia tanto quanto um aplicativo de medição de coisas depois de anos de demonstrações ARKit na WWDC. Foi estranho.)

Eu consegui ver uma rápida chamada do FaceTime com outra pessoa em um Vision Pro usando uma “persona” 3D gerada por IA (a Apple não gosta quando você os chama de “avatares”), o que foi impressionante e profundamente estranho. Era imediatamente óbvio que eu estava falando com uma persona de uma maneira estranha, especialmente porque a maior parte do rosto da pessoa estava congelada além de sua boca e olhos. Mas mesmo isso foi convincente depois de um tempo, e certamente muito mais agradável do que sua chamada média do Zoom. Você montou uma persona segurando o fone de ouvido na sua frente e deixando que ele escaneasse seu rosto, mas eu não fui capaz de configurar um sozinho e claramente há muito refinamento ainda por vir, então vou reter o julgamento até mais tarde.

Tudo isso foi basicamente um grande sucesso das demonstrações de VR, incluindo alguns standbys antigos: a Apple mostrou vídeos 180D de 3 graus com áudio espacial em algo chamado Apple Immersive Video Format, que a empresa aparentemente filmou com câmeras proprietárias que pode ou não lançar. (Eles se pareciam com os vídeos 3D que vemos em demonstrações de RV desde sempre.) Eu olhei para uma foto 3D de algumas crianças fofas tiradas pelas câmeras do fone de ouvido e assisti a um vídeo 3D dessas crianças soprando uma vela de aniversário. (Mesmo.) Fiz uma meditação Mindfulness de um minuto em que uma voz me ordenou a ser grata enquanto a sala escurecia e uma esfera de triângulos coloridos se expandia ao meu redor. (Isso parecia ótimo, mas Supernatural existe, tem milhões de usuários na Quest e oferece meditação guiada desde 2020.) E eu assisti Avatar no que parecia ser uma sala de cinema, que, bem, essa é uma das demos de realidade virtual mais antigas de todos os tempos.

Tudo isso foi melhorado pelo hardware Vision Pro extremamente superior? Sem dúvida. Mas tornou-se mais convincente? Eu não sei, e não tenho certeza se posso saber com apenas um curto período usando o dispositivo. Eu sei que usar essa coisa parecia estranhamente solitário. Como você assiste a um filme com outras pessoas em um Vision Pro? E se você quiser colaborar com as pessoas na sala com você e as pessoas no FaceTime? O que significa que a Apple quer que você use um fone de ouvido na festa de aniversário do seu filho? Há apenas mais perguntas do que respostas aqui, e algumas dessas perguntas atingem a própria natureza do que significa para nossas vidas serem literalmente mediadas por telas.

Também sei que a Apple ainda tem uma longa lista de coisas que quer refinar entre agora e o próximo ano, quando o Vision Pro for lançado. Essa é parte da razão pela qual está sendo anunciado na WWDC: para permitir que os desenvolvedores reajam a isso, descobrir que tipos de aplicativos eles podem criar e começar a usá-los. Mas essa é a mesma promessa que ouvimos sobre óculos de realidade virtual há anos, da Meta e de outros. A Apple pode claramente superar todos na indústria quando se trata de hardware, especialmente quando o custo aparentemente não é objeto. Mas o rolo de demonstração de fone de ouvido mais perfeito de todos os tempos ainda é apenas um rolo de demonstração de óculos de VR – se a famosa comunidade de desenvolvedores da Apple pode gerar um aplicativo matador para o Vision Pro ainda está no ar.

Fontes: https://www.theverge.com/2023/6/5/23750003/apple-vision-pro-hands-on-the-best-headset-demo-ever

https://www.theverge.com/2023/6/6/23751414/apple-tv-vision-pro-headset

Até semana que vem! 🙋 ♂️

PS – Se você quer levar assuntos e discussões como esta para a sua organização, avaliando como as tecnologias podem ajudar a gerar resultados para o seu negócio, clique aqui e vamos agendar um bate-papo.